Etică & guvernanță: cum folosești AI corect, sigur și responsabil

Secțiunea 2 · Lecția 3 — Etică & guvernanță: cum folosești AI corect, sigur și responsabil

AI în business nu e doar “wow”. E și risc: risc de confidențialitate, risc de bias, risc de decizii greșite, risc de reputație, risc legal. Și aici apare diferența dintre o companie care “se joacă” și o companie care adoptă AI matur: are reguli, roluri, procese și guardrails.

Lecția asta îți arată cum să folosești AI corect, sigur și responsabil — fără să încetinești inutil.

0) De ce etica & guvernanța NU sunt “birocrație”: sunt frâna care te ține în viață

În fiecare companie apare cineva care spune: “Ne omoară compliance-ul, noi vrem să inovăm”. Sună cool. Dar e o confuzie. Etica și guvernanța nu sunt “anti-inovație”.

Sunt sistemul care îți permite să inovezi fără să te auto-sabotezi.

AI amplifică.

Dacă ai un proces bun, AI îl face mai rapid și mai scalabil.

Dacă ai un proces prost, AI îl face prost mai rapid și mai scalabil.

Asta este motivul pentru care guvernanța devine esențială exact când AI devine popular.

Guvernanța nu îți ia viteza. Îți ia “viteza greșită” și îți dă “viteza sigură”.

🎬 Mică scenă: “AI-ul a zis…” și apoi începe dezastrul

Un manager primește un răspuns generat de AI și îl trimite mai departe ca “adevăr”.

Răspunsul conține o afirmație greșită despre o politică internă (sau despre un contract).

Se ia o decizie, apare un incident, apoi apare întrebarea: “de unde a venit informația?”.

Dacă răspunsul e “din AI”, ai deja o problemă. Corect e: “din documentul X, pagina Y, iar AI a sumarizat”.

AI fără trasabilitate (surse) produce “opinii plauzibile”, nu “informație de business”.

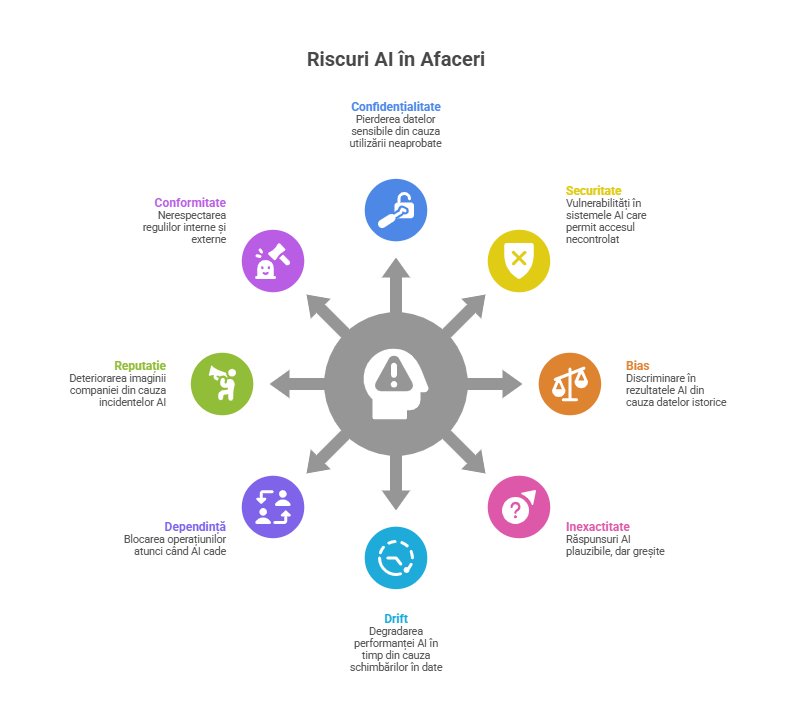

1) Ce riscuri aduce AI în companie (și cum le vezi înainte să te lovească)

Ca să guvernezi, trebuie să știi ce guvernezi. În AI, riscurile nu sunt doar “tehnice”. Sunt business, operaționale, legale și reputaționale.

🧨 8 categorii de risc (într-un limbaj de business)

1) Confidențialitate & date sensibile

Risc: date personale, date comerciale, secrete, contracte, prețuri, strategii ajung unde nu trebuie. Mai ales dacă oamenii copiază conținut în tool-uri neaprobate.

2) Securitate

Risc: prompt injection, exfiltrare de date, scurgeri prin log-uri, acces necontrolat. AI devine o “ușă” nouă în arhitectură.

3) Bias & discriminare

Risc: modelul tratează diferit grupuri de clienți/angajați din cauza datelor istorice sau a proxy-urilor. Poate crea probleme de fairness și legal.

4) Inexactitate / “halucinații” (mai ales la LLM)

Risc: răspunsuri plauzibile, dar greșite. Dacă nu ai surse, nu poți verifica rapid.

5) Drift (modelul îmbătrânește)

Risc: lumea se schimbă, datele se schimbă, comportamentul se schimbă, iar modelul devine mai slab. Fără monitorizare, nu observi până când pierzi bani.

6) Dependință operațională

Risc: procesul ajunge să depindă de AI fără fallback. Când AI cade (sau e oprit), business-ul se blochează.

7) Reputație

Risc: un incident mic cu AI poate deveni mare public. “Compania folosește AI și a făcut X”.

8) Conformitate / legal

Risc: nerespectarea regulilor interne sau externe, lipsa justificării deciziilor, lipsa audit trail.

Riscul #1 în AI nu este “modelul prost”. Este “folosirea necontrolată” a unui model bun.

2) Principiile “AI responsabil” — varianta care se poate aplica (nu poezie)

Când auzi “AI ethics”, multe documente sunt pline de cuvinte frumoase și zero implementare. Noi facem invers: principii scrise ca reguli care se pot verifica.

✅ 10 principii operaționale (scrise ca reguli de lucru)

- Purpose first: AI se folosește pentru o decizie clară (nu “pentru că e trendy”).

- Data minimization: folosim doar datele necesare (nu “aruncăm tot portofoliul”).

- Human in the loop: deciziile critice au validare umană (nu autopilot).

- Transparency: output-ul spune ce știe, ce nu știe și din ce surse (când e cazul).

- Explainability: pentru decizii cu impact, există justificare rezonabilă (în limbaj business).

- Fairness checks: verificăm efecte pe grupuri relevante (și remediem dacă e cazul).

- Security by design: acces, log-uri, protecție prompt injection, monitoring.

- Audit trail: păstrăm evidență: date, versiuni, schimbări, decizii, owner.

- Monitoring: măsurăm performanța și drift-ul; avem praguri de alertă.

- Fallback: procesul are plan B (manual / model simplu / reguli).

Dacă nu poți verifica un principiu în practică, nu e principiu. E slogan.

3) Guvernanță AI: cine decide ce (ca să nu devină “toți și nimeni”)

În business, guvernanța bună are o regulă simplă: fiecare lucru are un owner. În AI, avem mai multe roluri decât într-un proiect IT clasic, pentru că riscurile sunt diferite.

👥 Roluri recomandate (MVP) pentru AI în companie

- Business Owner: definește decizia, KPI-urile, acceptă/respinge rezultatul.

- Data Owner: răspunde de sursa de date și definiții.

- Model Owner: răspunde de model (versiuni, performanță, monitorizare).

- Risk/Compliance: definește guardrails, aprobă use case-urile sensibile.

- IT/Security: controlează accesul, log-urile, integrarea, securitatea.

- Legal: acoperă contracte, drepturi, utilizare, confidențialitate.

🏛️ Comitet AI (light): cum îl faci să ajute, nu să blocheze

Un comitet AI nu trebuie să fie “greu”. Un MVP bun:

- se întâlnește lunar (sau la nevoie)

- aprobă use case-uri cu risc ridicat

- revizuiește incidente și drift

- decide: “merge”, “merge cu condiții”, “nu merge”

Dacă comitetul nu are criterii clare, va decide pe bază de emoție. Criterii = viteză + consecvență.

4) AI Policy “MVP”: documentul minim care îți salvează compania de haos

Nu ai nevoie de 80 de pagini ca să începi. Ai nevoie de o politică minimă, clară, aplicabilă, pe care oamenii chiar o pot urma.

📄 AI Policy (MVP) — structură “copy-paste”

1) Scop

– De ce folosim AI și ce vrem să obținem (valoare business, eficiență, calitate)

2) Domeniu de aplicare

– Ce departamente/procese intră

– Ce tipuri de AI intră (predictiv, genAI, automatizări)

3) Clasificarea use case-urilor (low/med/high risk)

– Exemple pe fiecare categorie

– Cine aprobă fiecare categorie

4) Reguli pentru date

– Ce date sunt interzise (PII, secrete) în tool-uri neaprobate

– Data minimization

– Logging & retention (cine vede log-uri, cât timp)

5) Reguli pentru output

– Human-in-the-loop pentru decizii critice

– Marcarea limitelor (nu știe / incertitudine)

– Surse obligatorii pentru răspunsuri “fact” (RAG/links interne)

6) Securitate & acces

– Acces pe roluri

– Protecție prompt injection (pentru genAI)

– Audit trail

7) Monitorizare & revizuire

– KPI de performanță

– Praguri de drift

– Proces de retragere/opririre (kill switch)

8) Incident management

– Ce e incident

– Cine raportează

– Cum se investighează și se închide

AI Policy bună nu e “perfectă”. E clară, scurtă, aplicabilă și are un owner care o ține în viață.

5) Instrumente de control (“Guardrails”) în practică: cum oprești greșelile tipice înainte să se întâmple

Guardrails = reguli și mecanisme care limitează riscul. Nu sunt doar “spuse”. Sunt implementate. Cele mai utile guardrails sunt simple și repetabile.

🛡️ Guardrails pentru AI generativ (LLM) — cele care contează cel mai mult

- Răspuns pe surse: pentru politici/proceduri, răspunsul se bazează pe documente indexate (RAG).

- Refuz controlat: dacă nu există surse → “nu pot confirma” + cer clarificare.

- Context scurt: nu pui documente întregi în prompt “la grămadă”.

- Redaction: maschezi PII în prompt și în log-uri.

- Watermark intern: output-ul e marcat “AI-assisted” unde e cazul.

- Prompt injection defense: filtrezi instrucțiuni din text extern (“ignore rules and…”).

- Rate limits: controale pentru volum/abuz.

La LLM, riscul #1 este să pară sigur când nu e. De aceea: surse + refuz controlat.

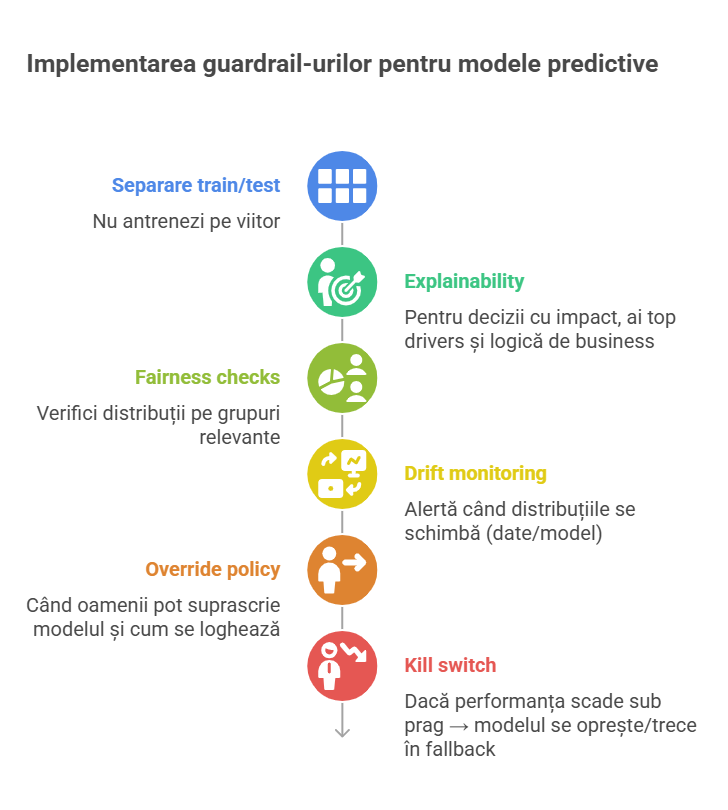

🧯 Guardrails pentru modele predictive (scoring, clasificare)

- Separare train/test: nu “antrenezi” pe viitor.

- Explainability: pentru decizii cu impact, ai top drivers și logică de business.

- Fairness checks: verifici distribuții pe grupuri relevante (unde e permis și relevant).

- Drift monitoring: alertă când distribuțiile se schimbă (date/model).

- Override policy: când oamenii pot suprascrie modelul și cum se loghează.

- Kill switch: dacă performanța scade sub prag → modelul se oprește/trece în fallback.

Un model matur nu e cel care “a fost bun”. E cel care rămâne bun și când lumea se schimbă.

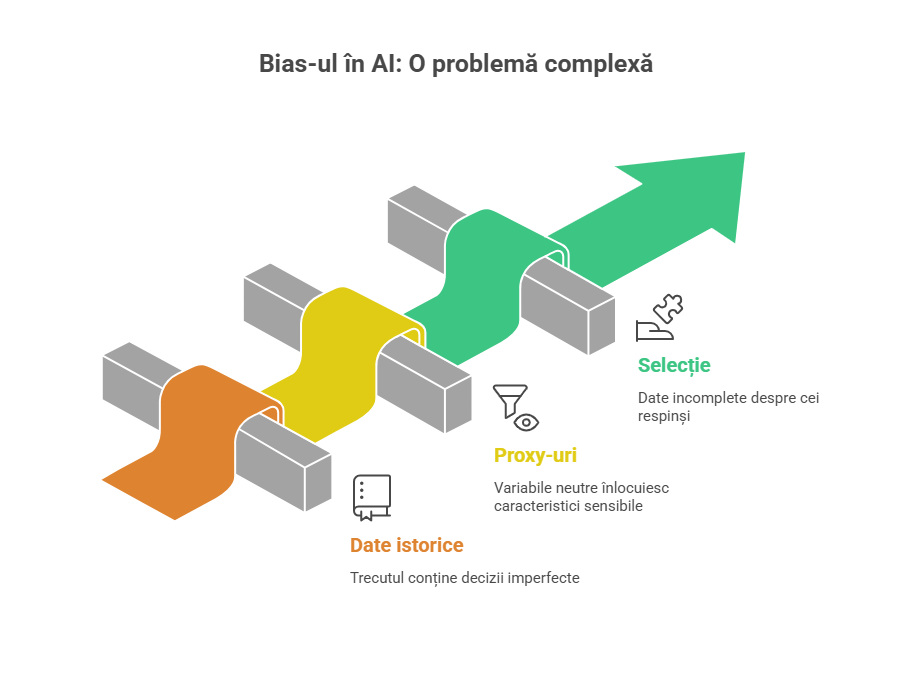

6) Etică “pe bune”: bias, fairness și decizii care afectează oameni

Bias-ul în AI este un subiect sensibil și, uneori, confuz. În business, abordarea sănătoasă este pragmatică: înțelegi unde există risc de efect nedrept și pui controale.

Bias-ul apare din 3 locuri tipice:

- Date istorice: trecutul conține decizii imperfecte; modelul le învață.

- Proxy-uri: variabile care par neutre, dar “înlocuiesc” o caracteristică sensibilă.

- Selecție: ai date doar despre cei care au intrat în proces (cei respinși nu au outcome).

✅ Ce înseamnă “fairness check” într-un mod simplu (fără matematică grea)

În termeni simpli, verifici dacă modelul produce rezultate disproporționate pe subgrupuri relevante, acolo unde e permis legal și relevant operațional.

Exemple de verificări:

- Rate de aprobare / respingere pe segmente

- Performanță (eroare) pe segmente

- Stabilitatea scorului în timp pe segmente

Cel mai periculos bias este cel invizibil: când nimeni nu verifică și toată lumea presupune că “modelul e obiectiv”.

7) Cum testezi și lansezi AI “responsabil”: checklist de go-live

Go-live fără checklist este loterie. Checklist-ul nu trebuie să fie lung, dar trebuie să fie clar. Mai jos ai un “go-live checklist” pe care îl poți folosi imediat.

🚀 Go-live checklist (MVP) — pentru orice soluție AI

A) Scop & decizie

[ ] Decizia este definită clar (ce schimbă în proces)

[ ] KPI-urile de succes sunt definite (timp/cost/quality/risc)

B) Date

[ ] Surse de date aprobate + acces controlat

[ ] Data dictionary minim

[ ] Reguli QA + monitorizare

C) Model / LLM

[ ] Versiune + documentare minimă

[ ] Testare pe date separate / scenarii

[ ] Limitări cunoscute (când nu e recomandat)

D) Risk & compliance

[ ] Clasificare risc (low/med/high)

[ ] Guardrails implementate (HITL, surse, refuz, logging)

[ ] Review legal/compliance unde e cazul

E) Securitate

[ ] Acces pe roluri

[ ] Log-uri + retention

[ ] Protecții (prompt injection, redaction)

F) Operațional

[ ] Owner pentru suport

[ ] Fallback definit

[ ] Plan de incident (cine, cum, când)

G) Monitorizare

[ ] KPI-uri + praguri

[ ] Drift monitoring

[ ] Kill switch / rollback

“Kill switch” nu e pesimism. E maturitate. Îți protejează business-ul când apar surprize.

8) AI în companie: cum educi oamenii ca să nu transforme AI în risc

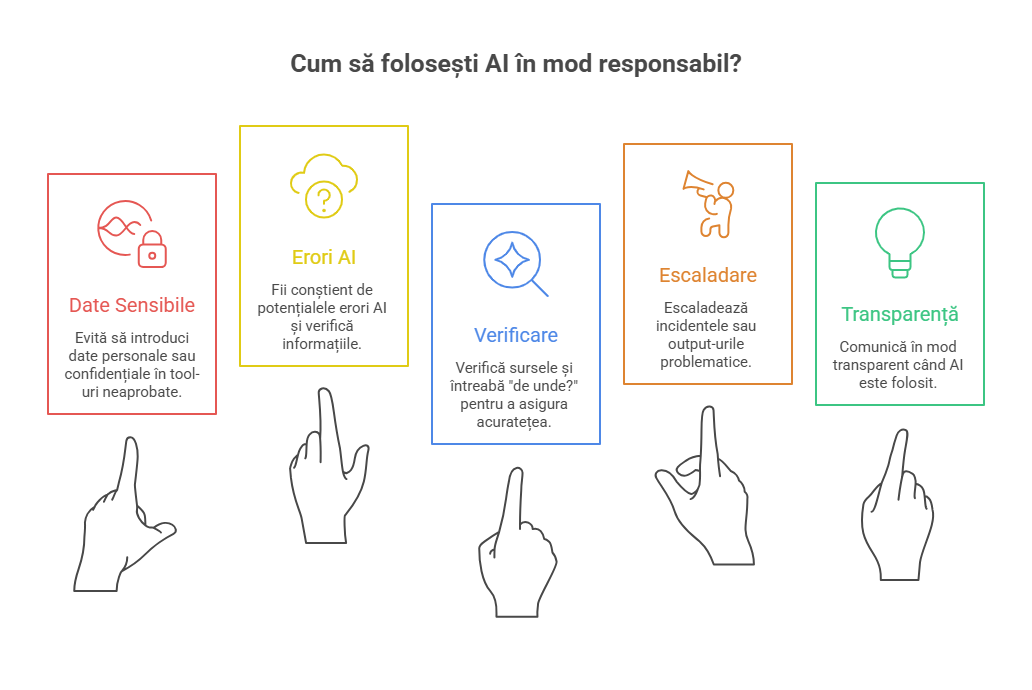

În practică, cele mai multe incidente nu vin din “model”, ci din utilizare greșită. De aceea, adopția sănătoasă include o mini-alfabetizare: oamenii trebuie să știe ce are voie și ce nu.

🎓 Training minim pentru utilizatori (30–45 min, recomandat)

- Ce date NU pui niciodată în tool-uri neaprobate (PII, contracte, strategii).

- Când AI poate greși (halucinații, lipsa surselor, ambiguitate).

- Cum verifici (surse, cross-check, întrebare “de unde?”).

- Când escaladezi (incident, suspiciune, output problematic).

- Ce înseamnă “AI-assisted” și cum comunici transparent.

9) Exercițiu: scrie o politică AI “MVP” pentru compania ta (în 25 de minute)

Exercițiul este simplu: folosești structura MVP și scrii o variantă scurtă.

Nu trebuie să fie perfectă. Trebuie să fie aplicabilă.

🧪 Exercițiu (template): AI Policy MVP — copiezi și completezi

1) Scop (2 rânduri):

______________________

2) Use case-uri permise (3 exemple):

– ______________________

– ______________________

– ______________________

3) Use case-uri sensibile (necesită aprobare) (3 exemple):

– ______________________

– ______________________

– ______________________

4) Reguli pentru date (3 reguli ferme):

– ______________________

– ______________________

– ______________________

5) Reguli pentru output (3 reguli ferme):

– ______________________

– ______________________

– ______________________

6) Owner & ritm:

Owner: ______________________

Revizuire: lunar / trimestrial

7) Incident:

Cine raportează: ______________________

Cum se oprește: ________________________

Vezi răspuns orientativ (cum arată “bun”)

Un MVP bun are: use case-uri permise vs sensibile, 3 reguli clare pentru date, 3 reguli pentru output, un owner și un proces de incident. Restul se poate rafina în timp.

Politica bună nu e cea “perfectă”. E cea pe care oamenii o înțeleg și o aplică.

10) Mini-quiz (consolidare) — răspunsurile sunt ascunse

Țintă: 4-6 minute.

Vezi răspuns

Vezi răspuns

Vezi răspuns

Vezi răspuns

11) Checklist de final (output-ul lecției)

- Înțeleg riscurile AI (privacy, securitate, bias, halucinații, drift, reputație, conformitate).

- Am principii operaționale (verificabile) pentru AI responsabil.

- Știu rolurile cheie (business/data/model/compliance/security) și cum arată un comitet AI “light”.

- Am o structură AI Policy MVP (scurtă și aplicabilă).

- Am guardrails practice pentru LLM și pentru modele predictive.

- Am un Go-live checklist și un exercițiu de politică AI.

Recap rapid (de ținut minte)

AI responsabil nu este “slow AI”. Este AI care poate fi scalat fără să se transforme în incident.

Cheia este guvernanța minimă: roluri clare, policy MVP, guardrails implementate, monitorizare și incident management.

Pentru LLM: surse (RAG) + refuz controlat.

Pentru predictiv: monitoring + drift + explainability + override policy.

Când ai aceste piese, AI devine o capacitate a companiei, nu o aventură.

🛡️ Guardrails

👥 Ownership

📉 Drift

🚨 Incident

Să crezi că “suntem mici, nu avem nevoie de guvernanță”. Exact companiile mici au nevoie de reguli simple, altfel AI devine haos rapid.

📝 Mini-quiz final (3-5 minute)

Vezi răspuns

Vezi răspuns

Vezi răspuns