Intro: Cum pui AI-ul la lucru în companie: fundația comună

Secțiunea 1 · Intro

În multe companii, discuția despre AI începe într-un mod care pare firesc, dar care de fapt este periculos. Cineva vede un demo spectaculos, altcineva citește despre un nou model, cineva din management întreabă dacă „nu putem și noi să facem ceva cu AI”, iar echipa începe să caute use case-uri.

Entuziasmul este real. Presiunea este reală. Curiozitatea este legitimă. Dar chiar aici apare prima capcană: organizația intră în discuție înainte să își clarifice limbajul.

Un manager spune „AI” și se gândește la un chatbot care răspunde la întrebări.

Un analist spune „AI” și se gândește la un model care estimează probabilitatea de default.

Un specialist de procese spune „AI” și se gândește la automatizarea aprobărilor și notificărilor.

Un coleg din IT spune „AI” și se gândește la un sistem integrat cu documente interne, controale de acces și loguri de audit.

Toți folosesc același cuvânt, dar vorbesc despre lucruri diferite.

O activitate care ar fi putut fi rezolvată printr-o regulă simplă este împinsă inutil spre un model generativ.

O analiză care cere date curate și definiții solide este tratată ca o conversație vagă cu un chatbot.

O sarcină cu miză ridicată este delegată prea mult unui sistem care produce text fluent, dar nu poartă responsabilitate și nu garantează adevărul.

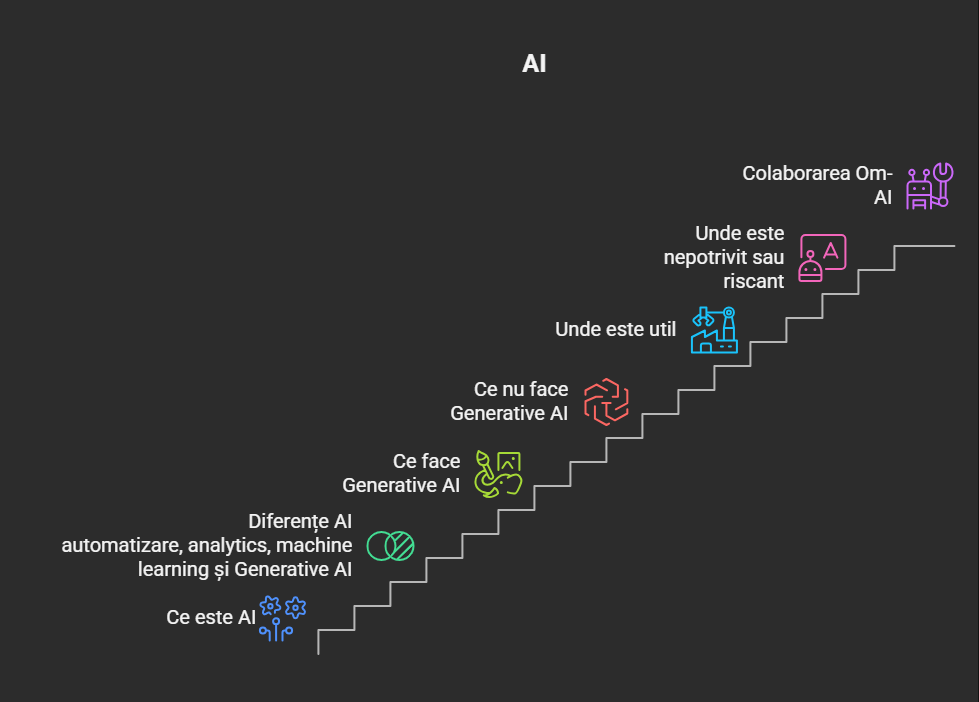

Acesta este motivul pentru care primul modul nu este o introducere formală, ci o fundație de lucru. Înainte să vorbim despre prompting, despre AI ca expert virtual, despre accelerare de cod, despre RAG (Retrieval-Augmented Generation), fine-tuning, agenți sau guvernanță, trebuie să răspundem clar la câteva întrebări esențiale:

- Ce este AI în context de companie?

- Ce diferență este între automatizare, analytics, machine learning și Generative AI?

- Ce anume face un model generativ și de ce pare atât de impresionant?

- Ce nu face?

- Pentru ce tipuri de activități este util?

- Pentru ce tipuri de activități este nepotrivit sau periculos?

- Cum identificăm realist ce putem da către AI, ce putem face cu AI și ce trebuie păstrat strict la om?

🚀 Scopul modulului este simplu, dar strategic: la final, cursantul să poată privi o activitate reală din munca sa și să spună, cu capul limpede, nu doar „aici merge AI”, ci mai ales ce tip de AI, în ce rol, în ce condiții și cu ce limitări.